You are using an out of date browser. It may not display this or other websites correctly.

You should upgrade or use an alternative browser.

You should upgrade or use an alternative browser.

Gráfica NVIDIA Turing (GTX 1600 series, RTX 2000 (Super) series, Quadro RTX)

- Autor do tópico pedrodbo

- Data Início

As Volta anunciadas não são para desktop, são para server/HPC/IA, para desktop também não vão sair já, ou então eu li mal.

ObscureAngel

I quit My Job for Folding

Epa, o GDDR6 até vai ser bastante rápido, mas esses 10% a menos de consumo é comparado exatamente como?

Por exemplo..

Com o mesmo bandwidth rating (320gb/s vs 320gb/s) ou (320gb/s vs 640gb/s)?

Por exemplo..

Com o mesmo bandwidth rating (320gb/s vs 320gb/s) ou (320gb/s vs 640gb/s)?

ObscureAngel

I quit My Job for Folding

@muddymind Mas pelo que estou a perceber, as GDDR6 à mesma frequência conseguem o dobro da largura de banda, é isso?

muddymind

1st Folding then Sex

Historicamente tem sido sempre mais largura de banda à custa de frequências maiores com tensões menores. Aumentas o consumo com o aumento de frequência mas como tens menos tensão acaba por contra-balançar.

No caso da GDDR6 não sei se está a ser feita mais alguma coisa pois ainda não foi revelado nada publicamente acerca do signaling utilizado.

No caso da GDDR6 não sei se está a ser feita mais alguma coisa pois ainda não foi revelado nada publicamente acerca do signaling utilizado.

eblain

Power Member

NVIDIA Volta Tesla V100 Cards Detailed – 150W Single-Slot & 300W Dual-Slot GV100 Powered PCIe Accelerators

Dá para ter uma ideia.

NVIDIA announced today two next generation cards based on its Volta graphics architecture and GV100 GPU. The new Tesla V100 accelerators will come in two different PCIe form factors, a 150W single-slot full height, half length design and a standard 300W dual-slot design. Both designs will house NVIDIA’s next generation GV100 GPU featuring 5120 Volta CUDA cores with 16GB of HBM2.

The GV100 Volta GPU that sits at the heart of each of these upcoming Tesla accelerators is a massive 815mm² chip with over 21 billion transistors built on TSMC’s new 12nm FinFET manufacturing process. At 1455MHz the Tesla V100 delivers 15 TFLOPS of single precision compute and 7.5 TFLOPS of double precision compute at 300W. It’s worthy of note that just like the P100, the V100 does not feature a fully unlocked GPU. The GV100 GPU houses 5376 CUDA cores but only 5120 are functional in the Tesla V100.

For hyperscale datacenters NVIDIA has managed to cram that same 815mm² GV100 GPU into a card the size of a CD case. At half the power the 150W hyperscale Tesla V100 naturally won’t be as fast as its 300W bigger brother but it’s close. How close? NVIDIA isn’t disclosing that information just yet.

Dá para ter uma ideia.

ObscureAngel

I quit My Job for Folding

A minha principal curiosidade é ver as inovações que vão ser efetuadas neste lançamento comparado às Pascal.

Sim já vi uma boa lista de coisas, mas é dificil saber ainda no que se traduz todos os melhoramentos apresentados.

Mas até lá ainda falta um bom bocado.

Sim já vi uma boa lista de coisas, mas é dificil saber ainda no que se traduz todos os melhoramentos apresentados.

Mas até lá ainda falta um bom bocado.

A cena mais nova é o tal "Tensor" core, agora se terá utilidade fora do mundo da AI...

O certo que estas features todas já faz sentido ter um motor de AI nos jogos a ser processado pela gráfica e não pelo CPU.

Uma coisa que notei hoje, que apesar de ser 12 nm, a densidade de transistores quase não mudou...

GV100: 21,1B e 815mm = 38,62mm2 por cada 1B transistores

GP100: 15,0B e 610mm = 40,66mm2 por cada 1B transistores

Ou seja se mantiver assim nas Geforces, teremos chips ainda maiores... Embora pode ser propositado, de forma a ter maior área de dissipação e diminuir o calor.

O certo que estas features todas já faz sentido ter um motor de AI nos jogos a ser processado pela gráfica e não pelo CPU.

Uma coisa que notei hoje, que apesar de ser 12 nm, a densidade de transistores quase não mudou...

GV100: 21,1B e 815mm = 38,62mm2 por cada 1B transistores

GP100: 15,0B e 610mm = 40,66mm2 por cada 1B transistores

Ou seja se mantiver assim nas Geforces, teremos chips ainda maiores... Embora pode ser propositado, de forma a ter maior área de dissipação e diminuir o calor.

O novo node da TSMC é 10nm, e este tal como os 20nm só para SoC, muito provavelmente apenas da Apple, o novo "long live node" será o 7nm. Ou seja o processo de 10nm é o preparativo para os 7nm, tal como os 20 foram para os 16.

Estes 12nm devem ser apenas uma melhoria/evolução, a Intel anda com os 14nm>14nm+>14nm++, estes subtraiem números

A Samsung já deve estar a produzir chips a 10nm com algumas características melhores que as da Intel, no papel e em teoria pelo menos, mas isso é peaners, pois o que interessa no final é as características do chip, em que o processo e arquitectura/desenho têm o seu peso.

Estes 12nm devem ser apenas uma melhoria/evolução, a Intel anda com os 14nm>14nm+>14nm++, estes subtraiem números

A Samsung já deve estar a produzir chips a 10nm com algumas características melhores que as da Intel, no papel e em teoria pelo menos, mas isso é peaners, pois o que interessa no final é as características do chip, em que o processo e arquitectura/desenho têm o seu peso.

Nemesis11

Power Member

Eu não vi o link por aqui, mas quem quiser ler mais sobre o GV100 (E digo GV100 e não Volta, porque tal como o Pascal, penso que a versão consumidor seja bastante diferente), pode ver este link: https://devblogs.nvidia.com/parallelforall/inside-volta/

A primeira coisa que salta à vista é a área deste chip. 815 mm2. Isto não é uma bolacha. Isto é uma pizza familiar.

Os yelds vão ser horríveis, não só pelo tamanho enorme do chip, como pelo "novo" processo de fabrico. Dito isto, a nVidia tem 2 modos de combater os péssimos yelds:

- O primeiro é só vender o chip com 80 SMs, quando ele tem 84. Isto é, mesmo que o chip esteja 100% bom, desabilitam 4 SMs. Os que tiverem até 4 SMs maus, sem outros defeitos, poderão ser usados.

- O segundo é o preço. Um brinquedo destes custa cada um entre 15 a 18 mil $ ao cliente, pelas minhas contas.

A diferença a nível de arquitectura entre a GP100 e GV100 é maior que o que esperava. Estava à espera mais de um speed bump e no entanto há bastantes diferenças entre os dois. O Tensor core, o sistema partilhado de L1, mudanças no thread scheduling, etc.

Fiquei um pouco desiludido ele continuar a "só" ter 16 GB de HBM2. Ter mais é bastante importante neste mercado. Parece que ainda não há ninguém a fabricar 8 stacks de HBM2. Por outro lado, a bandwidth aumentou bastante.

O Tensor core é do mais interessante neste GPU, no entanto parece-me serem unidades pouco flexíveis e apenas para um propósito. Não sei se é um grande risco dizer que penso que os Volta no mercado consumidor não terão estas unidade. Talvez a Titan V e por sua vez a 2080Ti.

Ser utilizado fora do mercado de AI e HPC? Tenho dúvidas, mas veremos.

Tal como a Pascal, penso que entre as GP100 e GV100 e os gpus para consumidor, há sérias diferenças.

Por fim, dizer que acho que mais tarde ou mais cedo a nVidia, se quiser continuar a apostar neste mercado, vai ter que deixar de fabricar só Gpus e fabricar ASICs só para o mercado de AI. Algo parecido com o TPU da Google.

Por exemplo, a Intel comprou uma empresa chamada Nervana, que aposta exactamente nesse mercado de ASICs para AI. O produto neste momento tem o nome de código de Intel Lake Crest e não deve faltar muito para sair. E não é a única empresa neste meio.

Podem ler mais aqui:

https://www.nervanasys.com/technology/engine/

https://www.nervanasys.com/nervana-engine-delivers-deep-learning-at-ludicrous-speed/

https://www.nextplatform.com/2016/08/08/deep-learning-chip-upstart-set-take-gpus-task/

https://www.nextplatform.com/2016/08/10/nervana-ceo-intel-acquisition-future-technology-outlook/

A primeira coisa que salta à vista é a área deste chip. 815 mm2. Isto não é uma bolacha. Isto é uma pizza familiar.

Os yelds vão ser horríveis, não só pelo tamanho enorme do chip, como pelo "novo" processo de fabrico. Dito isto, a nVidia tem 2 modos de combater os péssimos yelds:

- O primeiro é só vender o chip com 80 SMs, quando ele tem 84. Isto é, mesmo que o chip esteja 100% bom, desabilitam 4 SMs. Os que tiverem até 4 SMs maus, sem outros defeitos, poderão ser usados.

- O segundo é o preço. Um brinquedo destes custa cada um entre 15 a 18 mil $ ao cliente, pelas minhas contas.

A diferença a nível de arquitectura entre a GP100 e GV100 é maior que o que esperava. Estava à espera mais de um speed bump e no entanto há bastantes diferenças entre os dois. O Tensor core, o sistema partilhado de L1, mudanças no thread scheduling, etc.

Fiquei um pouco desiludido ele continuar a "só" ter 16 GB de HBM2. Ter mais é bastante importante neste mercado. Parece que ainda não há ninguém a fabricar 8 stacks de HBM2. Por outro lado, a bandwidth aumentou bastante.

A cena mais nova é o tal "Tensor" core, agora se terá utilidade fora do mundo da AI...

O Tensor core é do mais interessante neste GPU, no entanto parece-me serem unidades pouco flexíveis e apenas para um propósito. Não sei se é um grande risco dizer que penso que os Volta no mercado consumidor não terão estas unidade. Talvez a Titan V e por sua vez a 2080Ti.

Ser utilizado fora do mercado de AI e HPC? Tenho dúvidas, mas veremos.

Tal como a Pascal, penso que entre as GP100 e GV100 e os gpus para consumidor, há sérias diferenças.

Por fim, dizer que acho que mais tarde ou mais cedo a nVidia, se quiser continuar a apostar neste mercado, vai ter que deixar de fabricar só Gpus e fabricar ASICs só para o mercado de AI. Algo parecido com o TPU da Google.

Por exemplo, a Intel comprou uma empresa chamada Nervana, que aposta exactamente nesse mercado de ASICs para AI. O produto neste momento tem o nome de código de Intel Lake Crest e não deve faltar muito para sair. E não é a única empresa neste meio.

Podem ler mais aqui:

https://www.nervanasys.com/technology/engine/

https://www.nervanasys.com/nervana-engine-delivers-deep-learning-at-ludicrous-speed/

https://www.nextplatform.com/2016/08/08/deep-learning-chip-upstart-set-take-gpus-task/

https://www.nextplatform.com/2016/08/10/nervana-ceo-intel-acquisition-future-technology-outlook/

Qual é propósito do Tensor Core?

Quanto a cena de fabricar ASIC's só para AI, não é basicamente o que começaram a fazer com o GP100 e agora o GV100? São chips voltados para AI e não tanto para gráficos, ainda que chegou a existir uma gráfica com o GP100. E o GV100 tem ROP's e TMU's, portanto vai poder ser usado para gráficos tb.

A versão de consumidor provavelmente será igual o que ocorreu nas Pascal. Devem retirar uma boa parte do FP64, vir com GDDR5X e se calhar o Tensor core deve ser totalmente omitido, quanto muito deixam ai uns 5-10% deles...

Até porque não é viável sair uma bolacha deste tamanho... Terão que cortar algo para reduzir os transístores para uns 15-16B no máximo (GP102 tem 12B) para as Titans/2080 TI).

Já o HBM2, ainda me lembro que seria previsto até 8 GB por stack...

Quanto a cena de fabricar ASIC's só para AI, não é basicamente o que começaram a fazer com o GP100 e agora o GV100? São chips voltados para AI e não tanto para gráficos, ainda que chegou a existir uma gráfica com o GP100. E o GV100 tem ROP's e TMU's, portanto vai poder ser usado para gráficos tb.

A versão de consumidor provavelmente será igual o que ocorreu nas Pascal. Devem retirar uma boa parte do FP64, vir com GDDR5X e se calhar o Tensor core deve ser totalmente omitido, quanto muito deixam ai uns 5-10% deles...

Até porque não é viável sair uma bolacha deste tamanho... Terão que cortar algo para reduzir os transístores para uns 15-16B no máximo (GP102 tem 12B) para as Titans/2080 TI).

Já o HBM2, ainda me lembro que seria previsto até 8 GB por stack...

Nemesis11

Power Member

Qual é propósito do Tensor Core?

O nome vem do Tensorflow: https://www.tensorflow.org/

É um software desenvolvido inicialmente pela Google, open source, e é talvez o mais famoso na área de AI, actualmente.

Dito isto, ele pode ser usado noutras frameworks.

O objectivo é simples. Calcular matrizes o mais rapidamente possível. Cada 8 Tensor Cores por SM faz 1024 operações de virgula flutuante por clock. Agora multiplica por 80 SMs.

Os calculos são mixed precision, entre FP16 e FP32, o que não sei se não é precisão a mais (O TPU da Google usa INT 8)

Quanto a cena de fabricar ASIC's só para AI, não é basicamente o que começaram a fazer com o GP100 e agora o GV100? São chips voltados para AI e não tanto para gráficos, ainda que chegou a existir uma gráfica com o GP100. E o GV100 tem ROP's e TMU's, portanto vai poder ser usado para gráficos tb.

Mais ou menos. A GP100 deve ser o melhor chip para este tipo de cálculos, mas não é um ASIC de todo. Nem a GV100 é. Podes correr muita coisa nestes chips. Com Cuda, desde bases de dados a aplicações de HPC, há um pouco de tudo.

Os Tensor cores apontam para esse sentido, mas é apenas uma parte do chip.

ASIC é "Application specific integrated circuit". São chips que fazem apenas uma função. São muito pouco flexíveis, mas a nível de performance, normalmente é dificil de bater.

Acho que a nVidia não vai ter alternativa em criar um ASIC só com Tensor cores ou semelhantes.

A versão de consumidor provavelmente será igual o que ocorreu nas Pascal. Devem retirar uma boa parte do FP64, vir com GDDR5X e se calhar o Tensor core deve ser totalmente omitido, quanto muito deixam ai uns 5-10% deles...

A GP100 não é parecido à GP102 ou outro dos chips Pascal. Eu até acho complicado chamar Pascal à GP100 e ao mesmo tempo aos chips de consumidor. Se fores ver, até nas partes mais básicas, eles são bastante diferentes. Por exemplo, a GP102 tem 128 cuda cores FP32 por SM, enquanto a GP100 tem muito mais SMs, mas só com 64 cores FP32 por SM.

O número de unidades FP64 é o esperado. Muito diferente entre a GP100 e as versões consumidor.

Não espero ver os Tensor Cores em Gpus ao publico, mas posso estar enganado. Talvez nas Titan V, porque a própria nVidia a aponta para developers. E se estiverem na Titan V, também podem aparecer na Ti.

Até porque não é viável sair uma bolacha deste tamanho... Terão que cortar algo para reduzir os transístores para uns 15-16B no máximo (GP102 tem 12B) para as Titans/2080 TI).

Sendo um tweak no processo de fabrico, nem sei se podem ir tão longe. Como não espero versões Volta este ano, talvez possa ser possível, por estar o processo de fabrico mais maduro.

Já o HBM2, ainda me lembro que seria previsto até 8 GB por stack...

A Nervana (Agora, Intel, com o Lake Crest) prometeram um ASIC com 32 GB de HBM2 a correr a 1 Terabit/s em Q2 deste ano. Por isso é que fiquei um quanto ou tanto desiludido por a GV100 só ter 16GB.

Mais ou menos. A GP100 deve ser o melhor chip para este tipo de cálculos, mas não é um ASIC de todo. Nem a GV100 é. Podes correr muita coisa nestes chips. Com Cuda, desde bases de dados a aplicações de HPC, há um pouco de tudo.

Os Tensor cores apontam para esse sentido, mas é apenas uma parte do chip.

ASIC é "Application specific integrated circuit". São chips que fazem apenas uma função. São muito pouco flexíveis, mas a nível de performance, normalmente é dificil de bater.

Acho que a nVidia não vai ter alternativa em criar um ASIC só com Tensor cores ou semelhantes.

Pois, mas assim com o mesmo chip aborda vários mercados. Até que ponto é viável ter algo que só sirva para AI e tem na mesma que desenvolver o chip mais genérico na mesma? Claro que pronto um "GV100" só para AI deve ser um coisa descomunal...

Qualquer dia temos algo ao nível de um Terminator... FEAR!

A GP100 não é parecido à GP102 ou outro dos chips Pascal. Eu até acho complicado chamar Pascal à GP100 e ao mesmo tempo aos chips de consumidor. Se fores ver, até nas partes mais básicas, eles são bastante diferentes. Por exemplo, a GP102 tem 128 cuda cores FP32 por SM, enquanto a GP100 tem muito mais SMs, mas só com 64 cores FP32 por SM.

O número de unidades FP64 é o esperado. Muito diferente entre a GP100 e as versões consumidor.

Não espero ver os Tensor Cores em Gpus ao publico, mas posso estar enganado. Talvez nas Titan V, porque a própria nVidia a aponta para developers. E se estiverem na Titan V, também podem aparecer na Ti.

Yup, daí que as variantes GV10X devem vir bem diferentes... Quanto a Titan V, provavelmente vão usar o Tensor core para diferenciar da 2080 Ti, sendo que nesta ultima devem desativar parcialmente ou totalmente os Tensor's cores. Nas variantes para baixo se calhar deve ser suprimido totalmente a não ser que tenha utilidade para gamming e cia. (Porque não usar para a AI dos jogos?)

É que a diferença da Titan Xp de uma 1080 ti é apenas raw performance! Paga-se quase o dobro para ter mais 1 GB de memória e 256 shaders. A primeira Titan, ainda Kepler tinha como diferencial a enorme capacidade FP64 que nas 780(ti) foi capado propositadamente!

Pois, é que se a densidade for como é agora, não terão muita margem para esticar. Graficas consumidor só devem sair lá pro final do ano ou início 2018, nem tem necessidade de já puxar...Sendo um tweak no processo de fabrico, nem sei se podem ir tão longe. Como não espero versões Volta este ano, talvez possa ser possível, por estar o processo de fabrico mais maduro.

Isso a Nvidia lança mais pro final do ano o "V101" com todos os 84 grupos ativados, uns 1600 mhz de boost e 32 GB a 1 TB/s...A Nervana (Agora, Intel, com o Lake Crest) prometeram um ASIC com 32 GB de HBM2 a correr a 1 Terabit/s em Q2 deste ano. Por isso é que fiquei um quanto ou tanto desiludido por a GV100 só ter 16GB.

Nemesis11

Power Member

Pois, mas assim com o mesmo chip aborda vários mercados. Até que ponto é viável ter algo que só sirva para AI e tem na mesma que desenvolver o chip mais genérico na mesma? Claro que pronto um "GV100" só para AI deve ser um coisa descomunal...

É verdade que com a GP100 e a GV100 a nVidia tem bastante flexibilidade e cobre vários mercados. AI, HPC, Bases de dados, etc. A questão, parece-me a mim é que o que está a puxar os preços para cima e fazer com que a nVidia venda imediatamente cada uma que produz é o mercado de AI. Olha para os resultados da nVidia dentro do grupo Datacenter.

Depois há outros sinais. A google criou um ASIC para este mercado. Não sei se é a primeira vez que a Google faz um chip, mas pelo menos é o primeiro que mostra publicamente.

Um pdf a descreve-lo: https://arxiv.org/ftp/arxiv/papers/1704/1704.04760.pdf

Ele nem é muito complexo. Consome pouco, tem pouca área, apesar de ser feito a 28 nm mas tem excelentes resultados.

E agora olha para o ataque da Intel para este mercado:

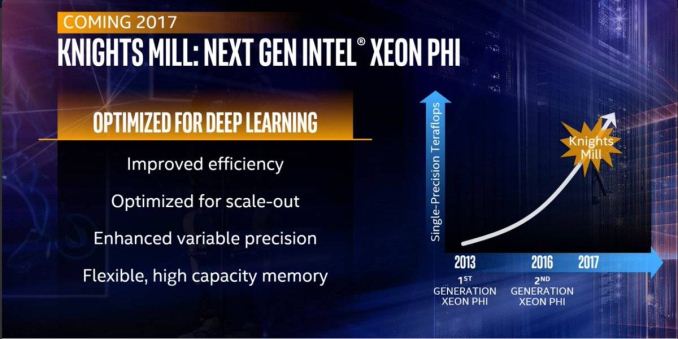

- Primeiro, tens o Knights Mill, que deve ser um Xeon Phi modificado para satisfazer este mercado de deep learning (menos precisão)

- Segundo tem o Lake Crest, antigo Nervana, que deve ser mesmo um ASIC só para este mercado e o Knights Crest, que será um Xeon bootable com tecnologia da Nervana:

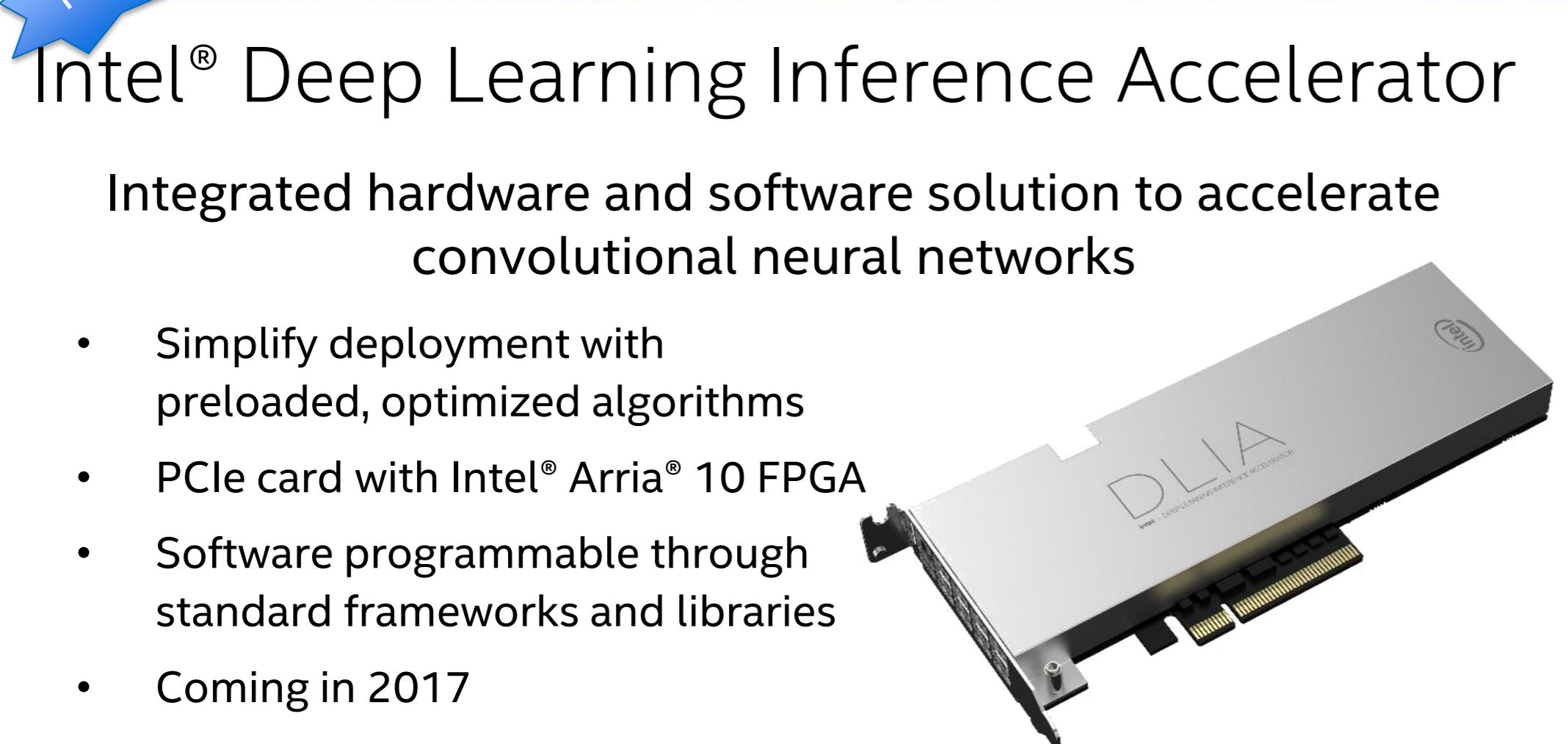

- Terceiro, será com os FPGAs da Altera, empresa que a Intel comprou. Vão lançar uma placa com um Arria 10 pensado para o mercado de AI:

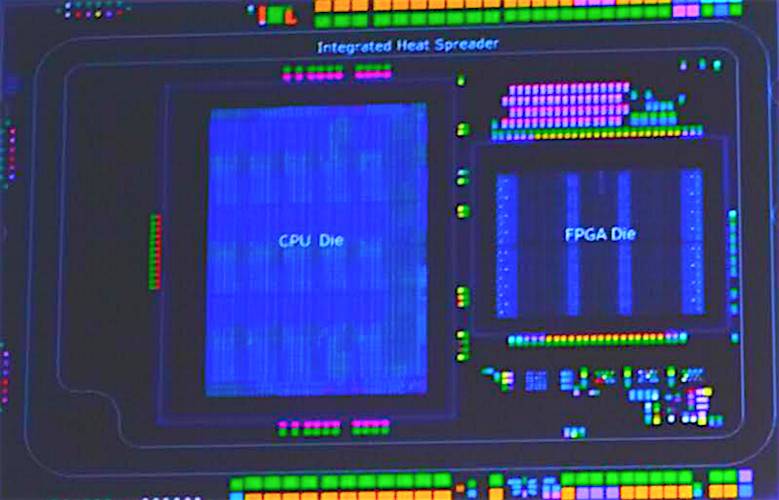

- Por último, o Broadwell (parece, com 15 cores) mais FPGA integrado no mesmo package:

A não ser que todos estes produtos sejam um falhanço, a nVidia vai ter que responder, se quiser manter este mercado. E não vejo melhor forma que não um ASIC com Tensor cores ou algo equivalente.

Além destas empresas, há mais startups a apostar neste mercado, normalmente com ASICs

Yup, daí que as variantes GV10X devem vir bem diferentes... Quanto a Titan V, provavelmente vão usar o Tensor core para diferenciar da 2080 Ti, sendo que nesta ultima devem desativar parcialmente ou totalmente os Tensor's cores. Nas variantes para baixo se calhar deve ser suprimido totalmente a não ser que tenha utilidade para gamming e cia. (Porque não usar para a AI dos jogos?)

É que a diferença da Titan Xp de uma 1080 ti é apenas raw performance! Paga-se quase o dobro para ter mais 1 GB de memória e 256 shaders. A primeira Titan, ainda Kepler tinha como diferencial a enorme capacidade FP64 que nas 780(ti) foi capado propositadamente!

Sim, as Titans actuais não fazem muito sentido. O nome Titan vem de um supercomputador que existe nos Estados Unidos, que usa nVidia pelo FP64 principalmente. No entanto isso foi cortado das Titans. Isto é, o próprio nome do produto já não faz sentido.

Adicionar os Tensor Cores era uma boa forma de diferenciar o produto e podia, com um custo baixo, atrair o pessoal que quer um acelerador para a sua workstation que acelere AI (e que não custe 69 mil $, como a workstation da nVidia).

Pois, é que se a densidade for como é agora, não terão muita margem para esticar. Graficas consumidor só devem sair lá pro final do ano ou início 2018, nem tem necessidade de já puxar...

Há um site alemão, que agora não me recordo qual era que dizia que Volta em consumidor, só em Q2 2018. Não sei se será assim tão tarde, mas não seria de admirar.

A nVidia neste momento, nos vários parâmetros, não tem concurrencia no mercado, a meu ver. Não precisa de estar a responder a nada. Duvido que tenha que responder à Vega da AMD.

Isso a Nvidia lança mais pro final do ano o "V101" com todos os 84 grupos ativados, uns 1600 mhz de boost e 32 GB a 1 TB/s...

A nVidia não lançou uma GP100 sem estar cortada (também estava cortada a GP100). Com 815 mm2 duvido que algum dia a nVidia lance a GV100 com todos os SMs activos. Uma versão com 32GB e talvez mais bandwidth, sim, já acredito bastante nessa possibilidade.